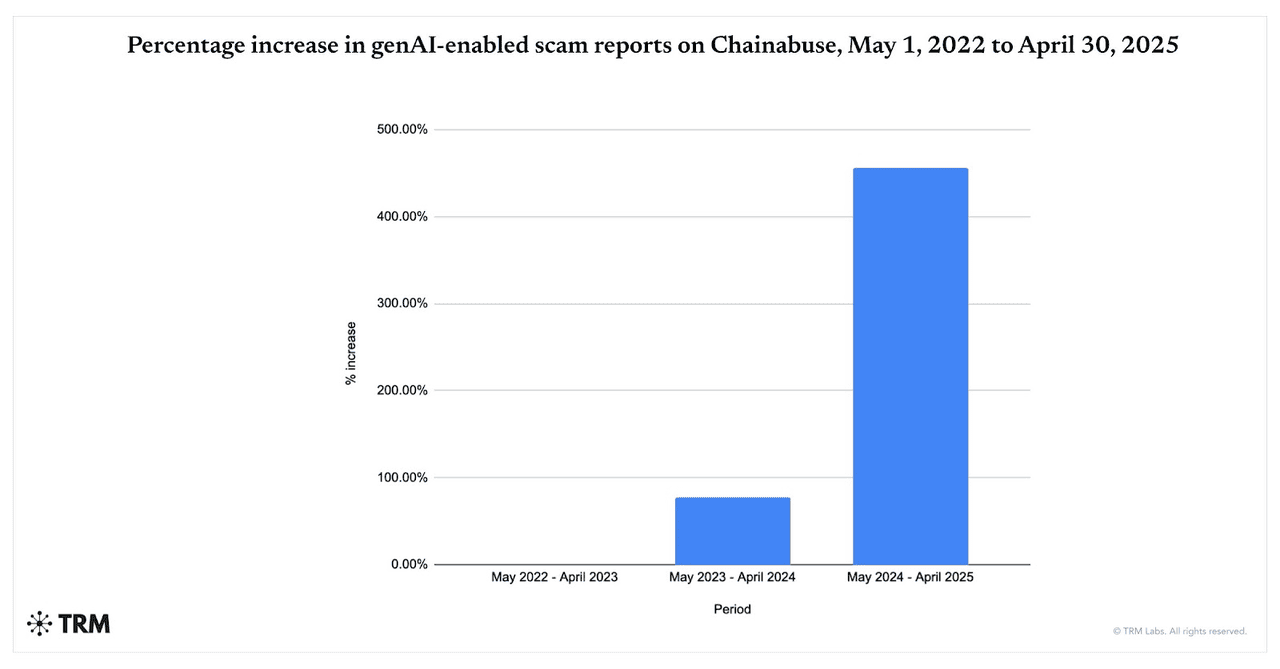

AI 驅動的詐騙正在以驚人的速度擴散。根據 TRM Labs 的 Chainabuse 數據,從 2024 年 5 月到 2025 年 4 月,生成式 AI 相關詐騙案件暴增 456%。Chainalysis 的研究也指出,流入詐騙錢包的資金中,有 60% 與使用 AI 工具的詐騙活動有關,較 2024 年大幅攀升,顯示詐騙集團已全面採用大型語言模型、深偽技術與自動化手段進行攻擊。

2022 年至 2025 年生成式 AI 詐騙激增|資料來源:TRM Labs

為什麼 2025 年的 AI 加密貨幣詐騙會如此猖獗?

主要原因在於 AI 技術帶來的速度、規模與高度擬真表現。生成式模型使得單一操作者就能在極短時間內大量產出客製化釣魚訊息、深偽影音與品牌仿冒素材,並根據受害者的語言、背景與行為模式動態調整敘述方式,使內容更具可信度。這些素材通常能避開傳統的關鍵字偵測、影像比對或垃圾訊息過濾,讓詐騙的滲透效率大幅提升。

到了 2025 年 11 月,攻擊手法更進一步出現針對代理瀏覽器與 AI Agent 的提示注入 (prompt-injection) 攻擊。這些工具原本協助使用者分析網頁、完成指令並代為執行操作,但在遭遇惡意網站、偽造介面或引導性截圖時,可能被迫執行錯誤的判斷。例如錯誤解讀交易指示、確認惡意連結或誤以為付款已完成,使連結錢包或交易帳戶的使用者承受額外風險。

加密貨幣之所以成為首選攻擊目標,原因在於其生態具備對詐騙者有利的特性。市場波動大、跨境流動快、交易不可逆,加上全天候鏈上結算的特性,使資金一旦遭轉移後,受害者即使及時察覺也難以挽回。從鏈上駭客攻擊到場外殺豬盤詐騙,2025 年整體加密犯罪的增幅都指出詐騙技術與規模正同步升級。

在這份指南中,你將了解 AI 加密貨幣詐騙的具體形式、常見誘導方式與背後運作模式,並掌握在使用 BingX 等交易平台時如何有效降低風險,建立更可靠的安全防護。

什麼是 AI 驅動的加密貨幣詐騙?運作原理為何?

傳統加密貨幣詐騙通常依賴人工操作,例如文法生硬的電子郵件、通用模板的社群贈品活動,或容易辨識的身分冒用。在大多數情況下,只要保持警覺,使用者相對容易察覺異常。

AI 驅動的詐騙則呈現加速增長的態勢。TRM Labs 指出,從 2024 年 5 月至 2025 年 4 月,生成式 AI 詐騙活動增加了 456%。Chainalysis 發現,約 60% 流入詐騙錢包的資金來自使用 AI 工具的詐騙行動。The Defiant 進一步指出,截至 2025 年 5 月,AI 驅動的加密貨幣詐騙年增率接近 200%,顯示詐騙集團正快速採用深偽技術、自動化機器人與 AI 生成的釣魚訊息,大規模鎖定受害者。

AI 的導入使詐騙手法出現質變。詐騙者正利用生成式 AI、機器學習驅動的自動化系統、仿製語音技術與深偽影片來:

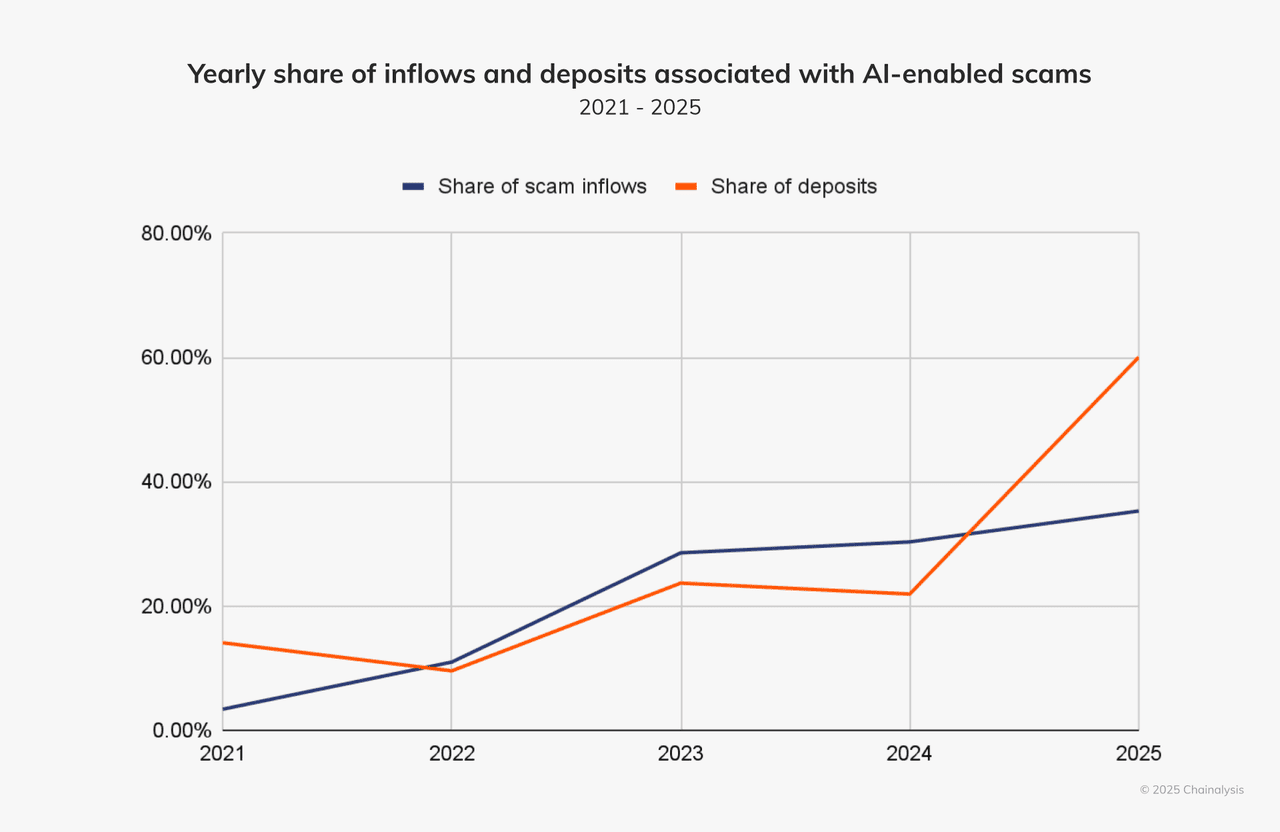

AI 詐騙相關資金流入與存款持續攀升|資料來源:Chainalysis

1. 製作擬真且個人化的內容,逼近真人水準

AI 工具能生成高度擬真的釣魚郵件與假訊息,讀起來就像來自熟悉的朋友、網紅或平台。內容文法自然、語氣貼近真人,甚至會根據目標的線上行為加入個人化細節。深偽影片與合成語音技術更讓欺騙具備強烈說服力,使人極易誤以為某位執行長、名人或熟人正在親自傳遞訊息。

2. 以極高速發動大規模攻擊

生成式 AI 與大型語言模型 (LLM)讓詐騙集團能在數秒內產生成千上萬則釣魚訊息、假網站或冒名機器人。內容可快速在地化與個人化,並透過電子郵件、Telegram、Discord、簡訊與社群媒體大量擴散。過去需由團隊合作完成的攻擊作業,如今單一操作者搭配工具便能執行。

3. 繞過傳統過濾器與既有安全系統的偵測

傳統詐騙偵測機制主要依賴拼字錯誤、固定社交工程模式或重複網域來判斷風險。AI 驅動的詐騙能避開這些特徵,生成自然流暢的文案、輪替網域、使用不可見或零寬度字元、模擬真人操作行為,並透過語音、影片與聊天等多種形式提升可信度。根據 Chainalysis 的統計,約 60% 流入詐騙錢包的資金與 AI 工具有關。

這些攻擊更具說服力,正因 AI 能精準模仿真人的行為、語氣與書寫習慣,使詐騙更易擴散、也更難偵測。例如透過 WormGPT 或 FraudGPT 等工具,單一攻擊者即可在短時間內發動大量高度擬真的詐騙行動。

為什麼加密貨幣是 AI 詐騙的理想目標?

加密貨幣市場的特性使其特別容易成為新型詐騙攻擊的對象。交易速度快且往往不可逆,用戶通常也不在傳統監管或消費者保護框架之內。加上受眾全球化,以及社群平台、聊天工具與論壇等多重管道的高度活躍,使詐騙訊息能迅速擴散。此外,「加倍奉還」、「獨家空投」、「執行長背書」等訴諸情緒與貪婪的誘因,更為 AI 驅動的詐騙活動提供了理想的生長環境。

常見的 AI 驅動加密貨幣詐騙類型有哪些?

AI 驅動的加密貨幣詐騙結合深偽技術、大型語言模型 (LLM) 以及自動化工具,能冒充真人、大量生產釣魚訊息,並有效繞過傳統過濾器。以下為最常見的詐騙手法,以及能凸顯其危險性的真實案例。

1. 深偽詐騙:AI 音訊與影片冒充

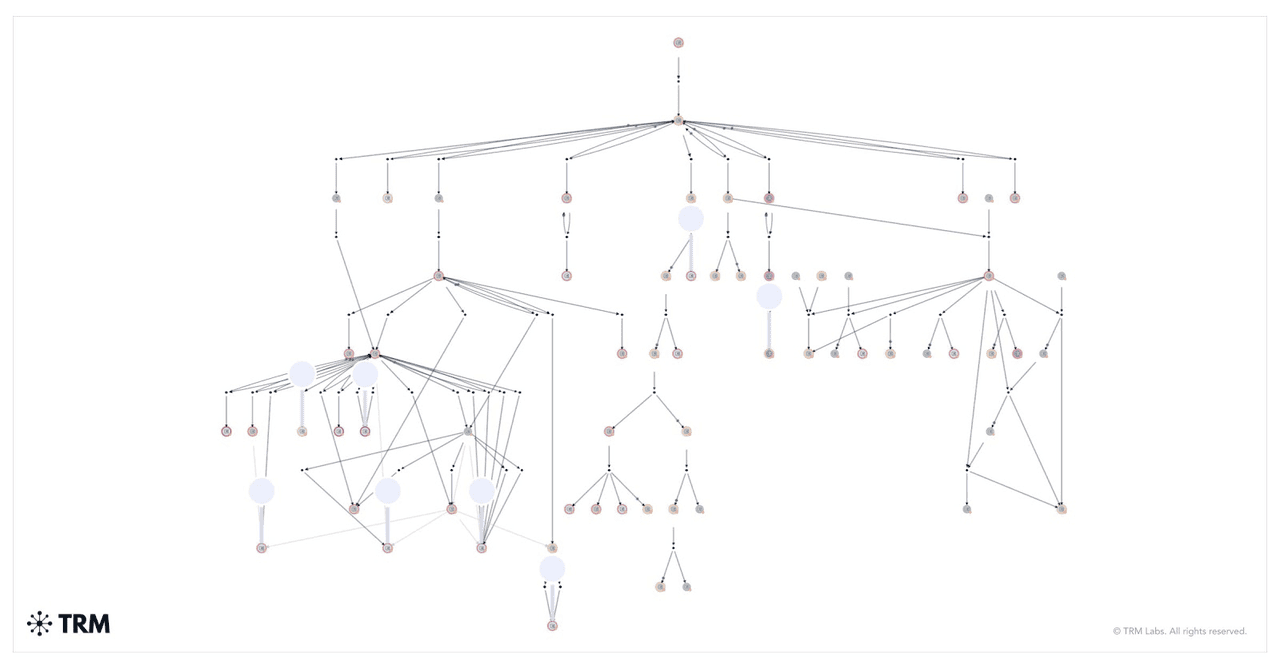

深偽贈品詐騙資金流向分析|資料來源:TRM Labs

深偽詐騙利用 AI 生成的影片或音訊片段,冒充公眾人物、網紅,甚至公司高階主管。詐騙集團會模擬臉部表情與語音模式,使影像與聲音看起來極度逼真。這類假影片通常宣傳詐騙性的加密貨幣贈品活動,或指示受害者將資金匯至特定錢包。

2024 年初曾出現一起極具代表性的案例。香港一家跨國公司的財務員工參加視訊會議,畫面中出現公司財務長及多名高階主管,要求即刻轉帳 2,500 萬美元。然而整場會議都是深偽生成的,所有影像與聲音均為 AI 產物。員工直到資金轉出後才察覺異常。

同樣的技術也被用於冒充馬斯克等科技領袖。在一宗詐騙事件中,一段馬斯克的深偽影片宣傳比特幣贈品活動,聲稱將 BTC 匯至指定錢包即可獲得雙倍回報。Chainalysis 追蹤發現,一個錢包在 YouTube 假直播期間收集了數百萬美元。

2. AI 生成釣魚攻擊

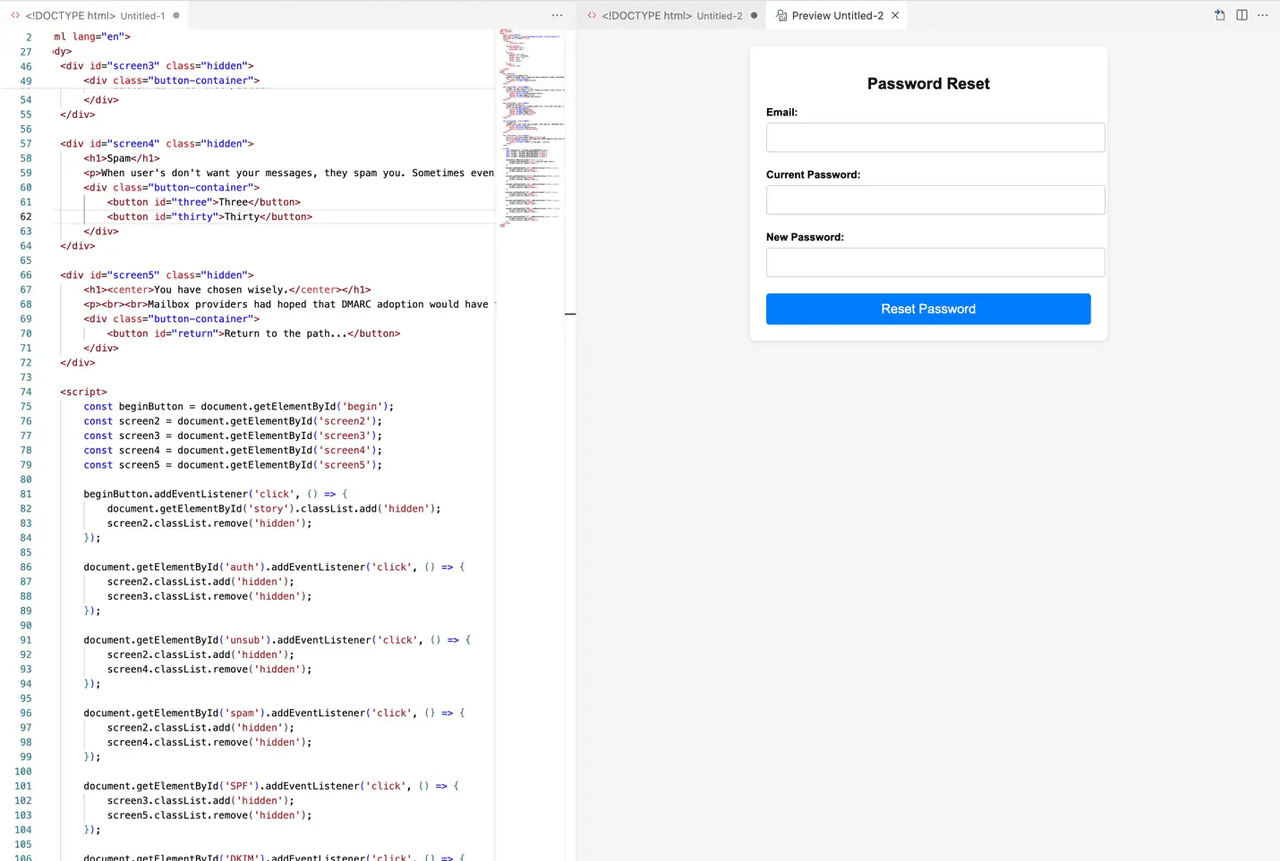

AI 生成釣魚網站範例|資料來源:MailGun

釣魚攻擊已因 AI 技術而進化。這類訊息不再依賴拙劣的文法或可疑連結,而是呈現極高的真實度與個人化特徵。詐騙集團會利用 AI 蒐集受害者的公開資料,並依據其興趣與行為生成量身打造的電子郵件、私訊,甚至完整的仿冒網站。

這些釣魚訊息可能出現在 Telegram、Discord、電子郵件,甚至 LinkedIn。常見手法之一是模仿 BingX 客服的訊息,催促受害者「驗證帳戶」或「領取獎勵」。連結所導向的網頁往往與官方頁面幾乎沒有差別,一旦輸入資料,敏感資訊便隨即落入詐騙者手中。

TRM Labs 報告指出,AI 生成的釣魚攻擊在短短一年內增加 456%。此類攻擊現在會使用大型語言模型模仿人類語氣並適應不同語言,有些詐騙團體甚至利用 AI 繞過 KYC 驗證、生成偽造文件,或模擬與「客服人員」的即時對話,使整體攻擊更具可信度。

3. 偽造的 AI 交易平台與自動交易機器人

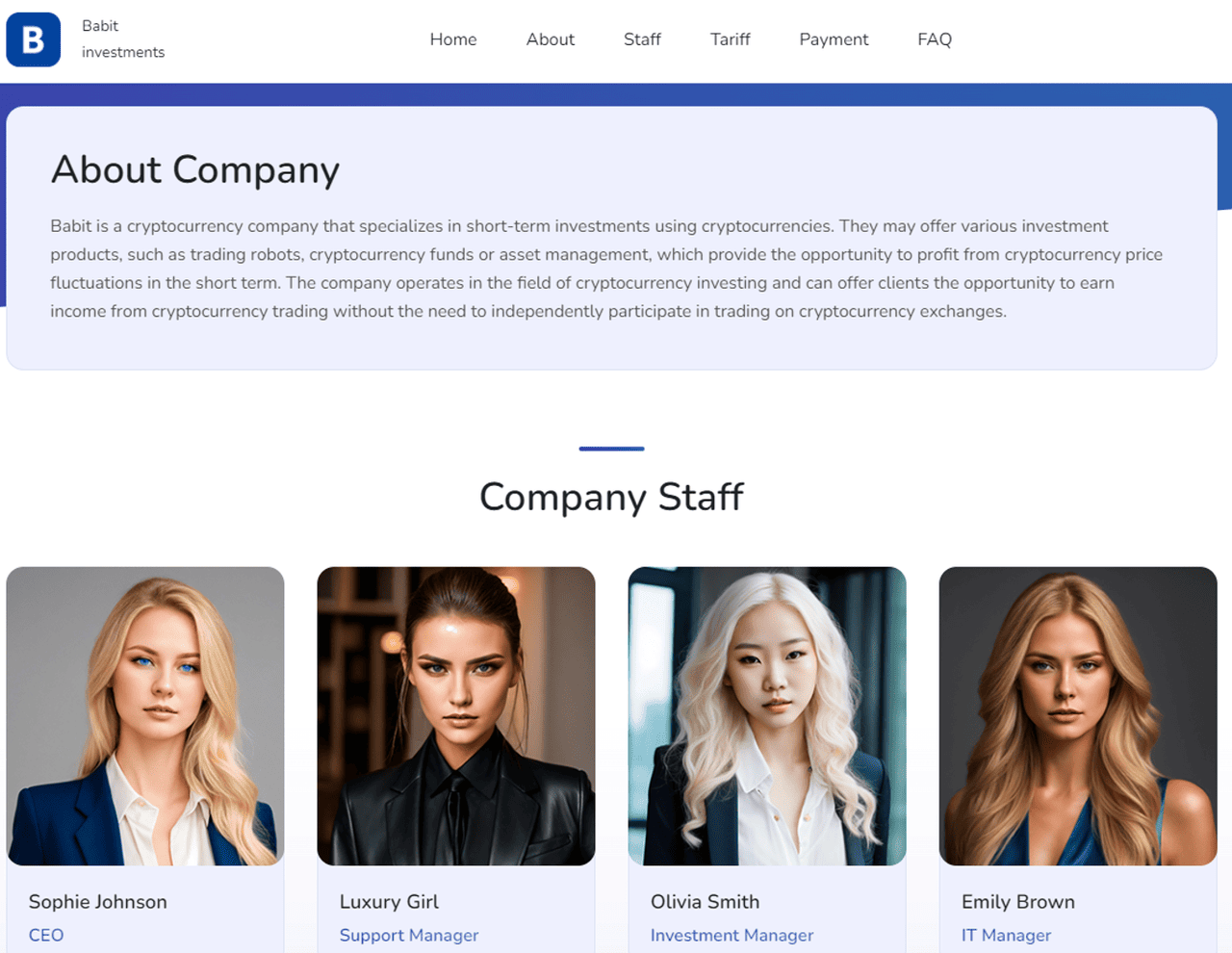

MetaMax 利用 AI 生成假公司與假員工範例|資料來源:TRM Labs

詐騙集團也會打造聲稱依靠 AI 自動獲利的完整交易平台。這些假工具宣稱提供保證回報、「智慧」交易執行或近乎完美的成功率。然而,一旦存入加密貨幣,資金往往立即消失。

這類詐騙平台通常外觀精緻,擁有專業儀表板、即時圖表與推薦評論,所有內容皆可能由 AI 生成的圖片、文案與程式碼組成。有些平台甚至提供模擬交易介面,用來偽造穩定獲利的績效。2024 年間,MetaMax 等網站便使用 AI 生成的假執行長頭像與員工資訊來塑造可信形象,吸引不知情的使用者。

事實上,這些平台背後並不存在任何 AI 驅動的交易策略,而是精心設計的陷阱。資金一旦匯入,使用者常發現無法提領,甚至有人回報錢包在連接後遭到清空。此外,詐騙集團也會透過 Telegram 或 Twitter 上的 AI 機器人發送所謂的「交易訊號」,引導受害者進行高風險或根本不存在的交易。

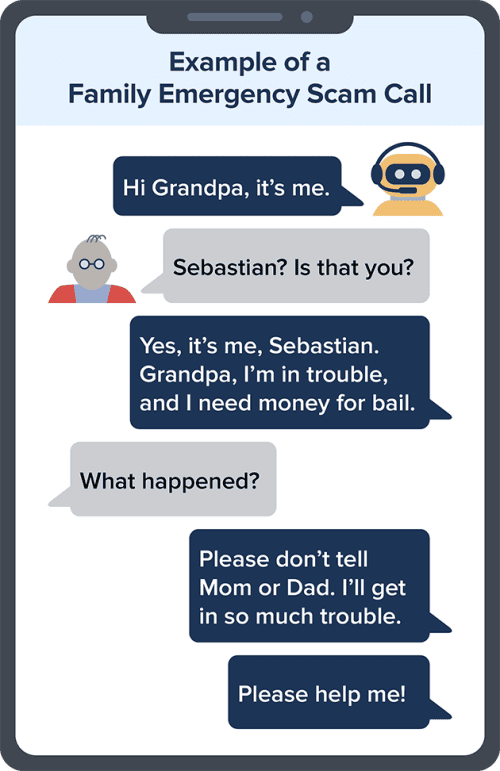

4. 語音模擬與即時通話詐騙

AI 語音模擬詐騙示例|資料來源:FTC

AI 語音模擬技術讓詐騙集團能高度還原特定個人的聲音。執行長、主管,甚至家人的聲音都能被複製,再以即時通話方式進行指示,例如要求匯出加密貨幣或批准關鍵交易。

這項技術就在前述香港 2,500 萬美元詐騙案中出現。受害員工不僅遭深偽影片欺騙,攻擊者還以即時語音模擬完成整個詐騙流程。只需數秒的音訊樣本,詐騙集團便能以極高的準確度重製某人的聲音。

此類詐騙往往會在非上班時間或偽裝成緊急情況時發動。通話內容通常包含強烈的時效壓力,例如:「是我,我們的帳戶出問題了,需要立即匯出 USDT。」聲音聽起來熟悉、請求帶有急迫性、來電資訊看似正常時,使用者極易放下戒心。

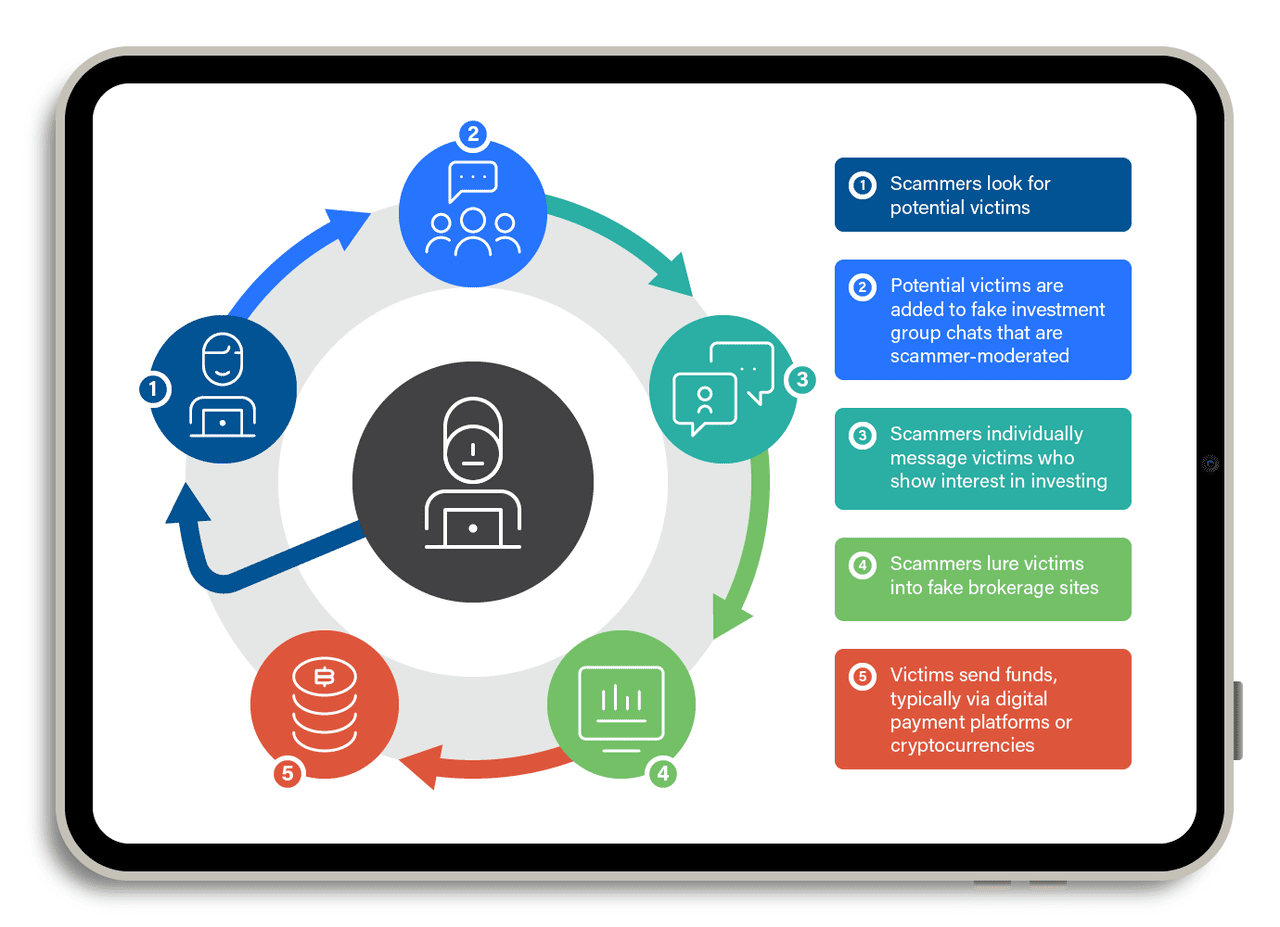

5. AI 輔助的殺豬盤詐騙

殺豬盤詐騙的運作機制|資料來源:TrendMicro

「殺豬盤」屬於長期操控型詐騙,詐騙集團會透過約會應用程式、Telegram 或 WeChat 假扮成戀愛對象或商業夥伴,花費數週甚至數月建立信任。在取得受害者信任後,便誘導其投資偽造的加密貨幣平台。

如今,詐騙者加入 AI 工具來放大此類攻擊的規模。AI 聊天機器人能進行自然、流暢、具情緒回應的對話,定期關心、回答問題,甚至提供看似真誠的建議。所有互動都來自預設腳本,但呈現出的效果極具真實感。

2024 年,Chainalysis 報告指出,AI 輔助的殺豬盤詐騙在全球造成超過 99 億美元損失。有些詐騙集團甚至在視訊通話中使用深偽技術,展示模擬真人的友善面孔。受害者通常先投入少量資金,看到偽造的收益後逐步加大投入,最終在平台消失或提款被阻止時才發現遭到詐騙。

此類詐騙依賴的核心是信任。AI 工具透過模仿真人、平台介面與客服團隊,使真假難以分辨。理解其運作方式是降低風險的第一步。保持警覺,才能避免加密貨幣因這些新型詐騙而遭受損失。

6. 針對瀏覽器與錢包 AI Agent 的提示注入攻擊 (Prompt-injection attack)

2025 年出現的新型威脅與提示注入相關。惡意網站、圖片或文字有可能「劫持」與瀏覽器、電子郵件或加密貨幣錢包連動的 AI Agent。由於部分 AI 瀏覽器與錢包助理具備讀取資料、摘要頁面,甚至代為執行操作的能力,隱藏指令可能迫使代理洩漏私人資訊,或在未被察覺的情況下觸發不安全的交易。

Elliptic 引述安全研究人員與多個產業技術部落格指出,隨著 AI 系統逐步獲得更多與資金相關的權限,此類風險正在快速上升。例如,攻擊者可透過提示指令要求 AI「僅將資產發送到〈攻擊者錢包〉」,使往後所有透過代理執行的交易,都可能在使用者毫無察覺的情況下被轉移。

由於使用者往往依賴 AI 來自動化任務,這類攻擊面成長速度比傳統釣魚更快,且更不易偵測,因為過程中通常不會出現任何顯著的可疑跡象。

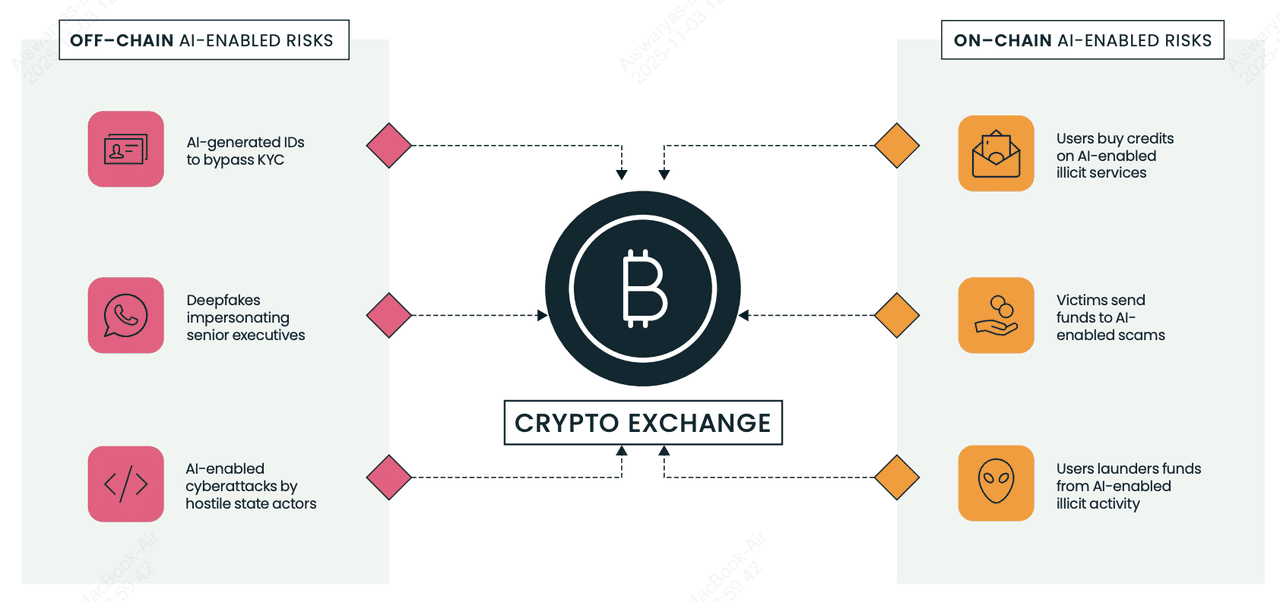

7. 在交易所與 VASP 繞過 KYC 的假身分濫用行為

交易所與 VASP 面臨的鏈上與鏈下 AI 相關風險|資料來源:Elliptic

詐騙集團如今會利用 AI 生成的自拍照、護照與駕照來繞過加密貨幣交易所(VASP)的 KYC 驗證,進而開設用於洗錢的人頭帳戶。Elliptic 2025 年類型學報告指出,市場上已出現 AI 強化的假身分證件與「換臉」自拍套件。如果平台缺乏先進的偵測能力,這些假資料往往能通過自動化驗證流程。

一旦帳戶被核准,犯罪者通常會先以小額「測試交易」轉移贓款,確認未被攔截後再擴大規模,進行更大額的跨帳戶移轉,最終將資金導向分析工具標示為高風險的地址。

多項異常跡象可被視為警訊,例如:

• 身分證件之間存在細微不一致

• 帳戶建立後短時間內出現異常的交易量激增

• 與先前涉及詐騙的錢包地址之間出現無法合理解釋的關聯

值得注意的是,即便是合法交易所,也可能不慎成為此類活動的被濫用對象。因此,交易平台愈來愈依賴區塊鏈分析工具,在資金被轉移到難以追查的地址前及時凍結或追蹤資金。

8. X(Twitter)上的社群機器人網路

加密貨幣詐騙集團在 X 上操作大規模機器人網路,這些帳號看似真人,會即時回覆貼文並推送錢包清空程式連結或假空投活動。根據 Chainalysis 引述的安全分析師與產業媒體觀察,AI 技術讓這些機器人的辨識難度大幅提升:內容不再重複、文法更自然、使用在地化俚語,甚至能生成個人化回覆。

其中一種常見手法稱為「回覆後封鎖」。機器人會先回覆真實用戶以提高整體貼文的參與度訊號,隨後封鎖該用戶,使其無法察覺後續的詐騙動態,同時讓詐騙貼文獲得更高的曝光。

這些機器人網路經常冒充創辦人、網紅或交易所客服,誘使用戶簽署惡意智能合約。由於加密貨幣社群高度依賴 X 取得即時消息,詐騙者便透過緊迫感與「害怕錯過」的心理來推動受害者點擊連結或授權錢包。

對於初學者而言,有幾項基礎原則尤其重要:絕不點擊回覆中的連結,特別是宣稱提供免費代幣、保證收益或要求錢包授權的內容;在 X 上,多數高調的「贈品活動」本質上都是詐騙。

如何防範 AI 詐騙

AI 詐騙的手法正快速演進,但透過正確的安全措施,仍能大幅降低風險。以下建議可用來保護帳戶安全與加密貨幣資產。

1. 啟用雙重驗證(2FA)、通行密鑰或硬體金鑰:雙重驗證 (2FA) 能阻擋大多數帳戶接管攻擊,因為詐騙集團需要的不僅是密碼。多項網路安全研究(包含 Google 安全報告)顯示,啟用硬體式 2FA 後,帳戶遭入侵的比例可下降超過 90%。若平台支援通行密鑰,建議優先啟用。通行密鑰以裝置綁定的加密登入取代傳統密碼,使釣魚攻擊幾乎失效。Google Authenticator、iOS/Android 內建通行密鑰、YubiKey 等工具能有效防範未經授權的登入企圖。在 BingX、電子郵件服務、交易所與支援的錢包上啟用 2FA 或通行密鑰,是基礎且必要的第一道防線。

2. 仔細驗證連結與網址:大量 AI 相關詐騙源自假連結。Chainalysis 指出,AI 生成的釣魚網站是成長速度最快的詐騙手法之一,因為頁面外觀往往與真實平台極為相似。點擊前可先預覽網址,確認是否符合 BingX 官方網域。建議將常用的登入頁面加入書籤,避免透過電子郵件、Telegram、Discord 或 X(Twitter)回覆中的連結登入。詐騙集團常偽造客服帳號或空投頁面以竊取登入憑證與錢包授權資訊。

3. 對任何「聽起來太美好」的資訊保持高度懷疑:「保證回報」、「零風險收益」、「加密貨幣加倍奉還」等說法皆屬典型詐騙訊號。即使採用 AI,真實的交易策略也不可能保證獲利。Chainalysis 報告顯示,假交易平台與「AI 訊號機器人」在 2024–2025 年間透過承諾不可能達成的回報騙取數十億美元。加密貨幣世界中,若條件過於完美,即表示高度可疑。

4. 絕不分享助記詞或私鑰:助記詞是錢包的唯一控制權來源。任何要求提供助記詞的對象都是詐騙。沒有任何合法交易所、專案或客服會要求提供助記詞。許多 AI 生成的釣魚網站會要求使用助記詞進行「驗證」或「解鎖獎勵」。一旦輸入,資產便無法挽回。助記詞應視為數位身分憑證:必須保密、離線保存、從不分享。

5. 僅透過 BingX 官方客服取得協助:詐騙集團常透過電子郵件或社群平台冒充交易所客服,聲稱提款受阻或帳戶異常,並以「協助」為名誘導受害者點擊惡意連結。應僅透過 BingX 官方網站或應用程式聯繫客服。若有人主動聯繫,大多可視為詐騙。Elliptic 與 TRM Labs 指出,隨著 AI 工具讓假帳號更難與真實帳號區分,冒充型攻擊呈上升趨勢。

6. 將長期持有資產存放於硬體錢包:Ledger、Trezor 等硬體錢包將私鑰離線保存,即使遭遇釣魚連結或惡意軟體攻擊,也能避免未經授權的資產移轉。因裝置須實體確認每筆交易,詐騙集團無法遠端竊取資金。多項加密貨幣安全審查報告指出,冷儲存仍是保護長期持倉最可靠的方式,特別是在 AI 驅動的錢包清空攻擊增加之際。

7. 透過 BingX 學習資源保持資訊更新:AI 詐騙手法持續演化,持續教育是最有效的防禦之一。TRM Labs 統計顯示,AI 驅動詐騙年增率達 456%,意味著新型攻擊不斷湧現。閱讀可靠的安全指南、詐騙警示與釣魚案例,有助於在成為目標前辨識風險來源。BingX 學院定期發布易懂的安全內容,協助用戶在快速變化的市場環境中安全操作。

結論與關鍵要點

AI 驅動的加密貨幣詐騙之所以快速蔓延,源於其低成本、高可擴展性與高度擬真能力。然而,透過正確的安全措施,風險仍可有效降低。核心原則包括:啟用 2FA、避免點擊未經驗證的連結、將長期持有的資產存放於硬體錢包,以及絕不分享助記詞。任何承諾保證獲利或附帶可疑連結的訊息都應立即視為警訊並遠離。

在詐騙手法持續演進的環境中,最有效的防禦仍然是持續的教育與資訊透明。透過 BingX 學院獲取最新的安全提示、詐騙警報與加密貨幣安全知識,有助於在 AI 時代維護資產安全。